Två sätt att bygga en AI-voicebot: stitching mot realtid

Hur en AI-voicebot bearbetar tal avgör om den låter naturlig eller långsam och opålitlig. För närvarande finns två arkitekturer i användning bland utvecklare, och valet mellan dem påverkar samtalsupplevelsen, systemets tillförlitlighet och vad boten kan få ut ur ett samtal. Den äldre metoden knyter tre separata komponenter efter varandra, medan den nya metoden bearbetar hela samtalet på en gång.

Den klassiska tillvägagångssättet: stitching

När de första voicebots byggdes var det logiskt att knyta samman tre befintliga komponenter. Inkommande tal gick genom en tal-till-text-motor som gjorde det till text, sedan läste en språkmodell denna text och formulerade ett svar, och slutligen konverterade en text-till-tal-motor det svaret tillbaka till hörbara ord. Denna arkitektur kallas “stitching” inom sektorn, eftersom du knyter ihop tre oberoende system till en kedja.

Under en tid gav det användbara resultat, och för team som inte ville träna sin egen talmodell var det den enda praktiska vägen. Ändå uppstår tre sårbarheter i praktiken, eftersom varje länk separat kan falera. Taligenkänningen kan höra en mening felaktigt, språkmodellen kan ge ett långsamt eller felaktigt svar och talsyntes kan fallera vid dåligt tidpunkt. Många team bygger därför in en reservväg med en alternativ TTS- eller LLM-leverantör, så boten fortsätter att fungera vid ett avbrott. Det löser avbrottet, men samtalsdeltagare hör plötsligt en helt annan röst och blir förvirrad över vem de egentligen talar med.

Den andra nackdelen väger kanske ännu tyngre. Med stitching ser språkmodellen endast en texttranskription, vilket gör att den inte kan uppfatta tonen, volymen, tveksamheten och känslan hos samtalsdeltagaren. En irriterad kund och en nöjd kund låter identiska för modellen när deras ord står på papper, och det går på bekostnad av den kontextkänslighet som gör ett samtal värdefullt. Signaler om misstänkt ålder, modersmål eller stämning försvinner i översättningen till text, medan just dessa signaler ofta avgör hur en medarbetare skulle föra samtalet.

Den nya metoden: en enda realtidstalmodell

Sedan OpenAI den 24 februari 2026 gjorde gpt-realtime-1.5 tillgänglig finns det ett andra sätt att bygga voicebots som i de flesta fall fungerar bättre. I stället för tre separata komponenter efter varandra hör och talar en enda modell direkt, vilket eliminerar hela mellanlagret för transkription och syntes. Modellen förstår orden, tonen och känslan från samtalsdeltagaren samtidigt, så den kan omedelbar reagera på det i sitt svar. En demo från Charlierguo visar väl hur smidigt det fungerar i praktiken.

Det ger konkreta fördelar i daglig användning. Det finns bara en punkt där något kan fallera i stället för tre, vilket minskar avbrottsrisken avsevärt. Reaktionstiden ligger vanligtvis under 400 millisekunder, så samtalet flödar naturligt utan den fördröjning som uppstår vid stitching. Flerspråkighet är inbyggt, vilket gör att samma modell enkelt växlar mellan svenska, engelska, tyska och andra språk utan att du behöver ställa in växlingen i förväg. Och eftersom modellen bearbetar tal i stället för text kan den känna igen en irriterad kund på rösten och kan vidarebefordra honom eller henne direkt till en medarbetare utan att ett nyckelord eller explicit eskalering behövs.

När stitching fortfarande är rätt val

Det finns fortfarande en nisch där den äldre arkitekturen passar bättre, och det är situationer där inget direkt samtal behöver föras utan istället en inspelning analyseras senare. När ett callcenter efter ett samtal vill få samtal sammanfattade, kodade eller granskat för regelöverensstämmelse finns det ingen latensbegränsning och du kan lugnt välja en specialiserad språkmodell. Tänk på en medicinsk språkmodell som känner igen förkortningar och facktermer inom sjukvård, eller en tal-till-text-motor som särskilt är tränad på en regional dialekt. Precisionen på den enskilda komponenten väger tyngre än den övergripande samtalsupplevelsen i dessa scenarier, eftersom det inte finns någon samtalsdeltagare på linjen som väntar på svar.

Vår rekommendation

För företag som vill få voicebots att hantera direkta samtal rekommenderar vi i nästan alla fall realtidsmetoden. Kombinationen av snabbare reaktion, mindre felkänslighet, flerspråkighet utan konfiguration och känsla för ton skapar en samtalsupplevelse som samtalsdeltagare inte uppfattar som robotaktig. För analys efter samtal och andra scenarier där precision på en specifik komponent är avgörande fortsätter vi att använda stitching-arkitekturer, eftersom de fortfarande ger det starkaste resultatet där.

Vårt team bygger i båda arkitekturerna

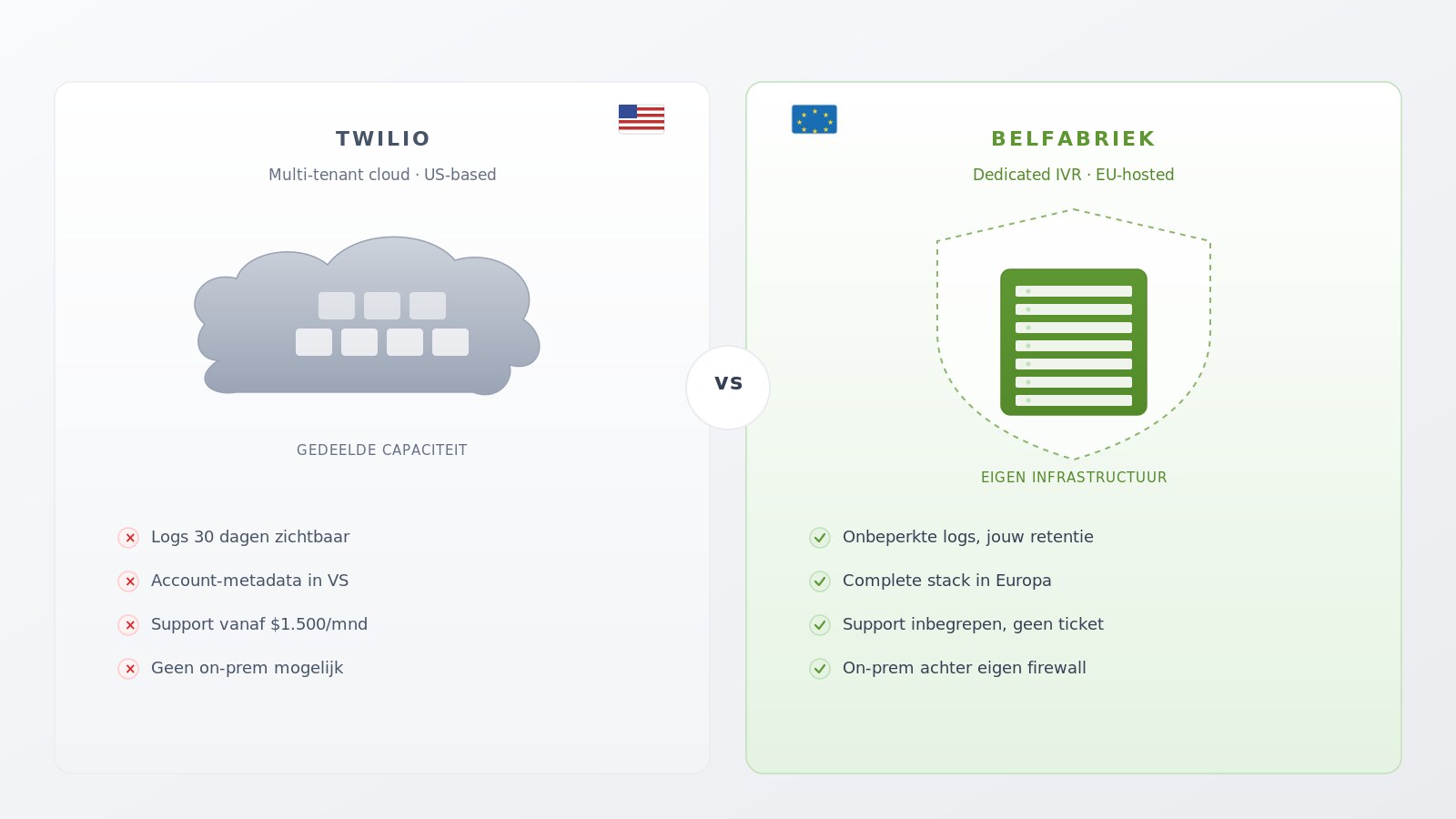

CallFactory bygger voicebots i båda arkitekturerna, beroende på vad som passar bäst för ditt samtaltsflöde. Oavsett om du vill ha en helt hanterad lösning där vårt team ställer in allt från början till slut, eller om du istället vill ha en dedicerad IVR på din egen infrastruktur, levererar vi GDPR-kompatibla implementeringar som är tillgängliga 24 timmar om dygnet, sju dagar i veckan.

Kontakta vårt team för att diskutera vilken arkitektur som passar bäst för dina samtal, hur integrationen med dina befintliga system fungerar och inom vilken tidsram voiceboten kan gå live. Så får du en tydlig bedömning av genomloppstiden och investeringen, och från dag ett kan du låta en voicebot hantera inkommande och utgående samtal som talar och lyssnar på ett sätt som för inte länge sedan var otänkbart.

Vanliga frågor

Stitching är värdefullt när du inte behöver föra ett direkt samtal utan istället vill analysera en inspelning senare. Då har du friheten att välja en specialiserad språkmodell, som en medicinsk modell för sjukvårdsterminologi eller en tal-till-text-motor som är tränad på en regional dialekt. I dessa fall väger precision på en enskild komponent tyngre än en smidig samtalsupplevelse.

Reaktionstiden ligger vanligtvis under 400 millisekunder, vilket är jämförbart med ett vanligt samtal mellan två människor. Eftersom det inte finns några separata komponenter efter varandra försvinner helt den fördröjning som uppstår vid stitching, så samtalsdeltagare märker sällan direkt att de talar med en AI.

Ja. Realtidstalmodeller är tränade på flera språk, vilket gör att de kan växla mellan svenska, engelska, tyska och andra språk under samma samtal utan att du behöver ställa in växlingen i förväg. För företag med en internationell kundkrets försvinner därmed ett helt konfigurationssteg.

Vi bygger in en reservväg för varje projekt, så att samtalet automatiskt övergår till en medarbetare eller till ett inspelat meddelande vid avbrott. Samtalsdeltagaren märker bara att samtalet överförs, så ditt samtaltsflöde förblir funktionellt även vid ett avbrott från leverantörens sida.

Ja. Vi bygger voiceboten så att ljud och metadata stannar inom Europeiska unionen och så att det finns ett databehandlaravtal med alla inblandade parter. För reglerade sektorer som sjukvård, banker och försäkringsgivare levererar vi dessutom en egenvärdad variant som körs helt bakom din egen brandvägg.